- 개요

- 제품 동영상---GPU

- 관련 제품

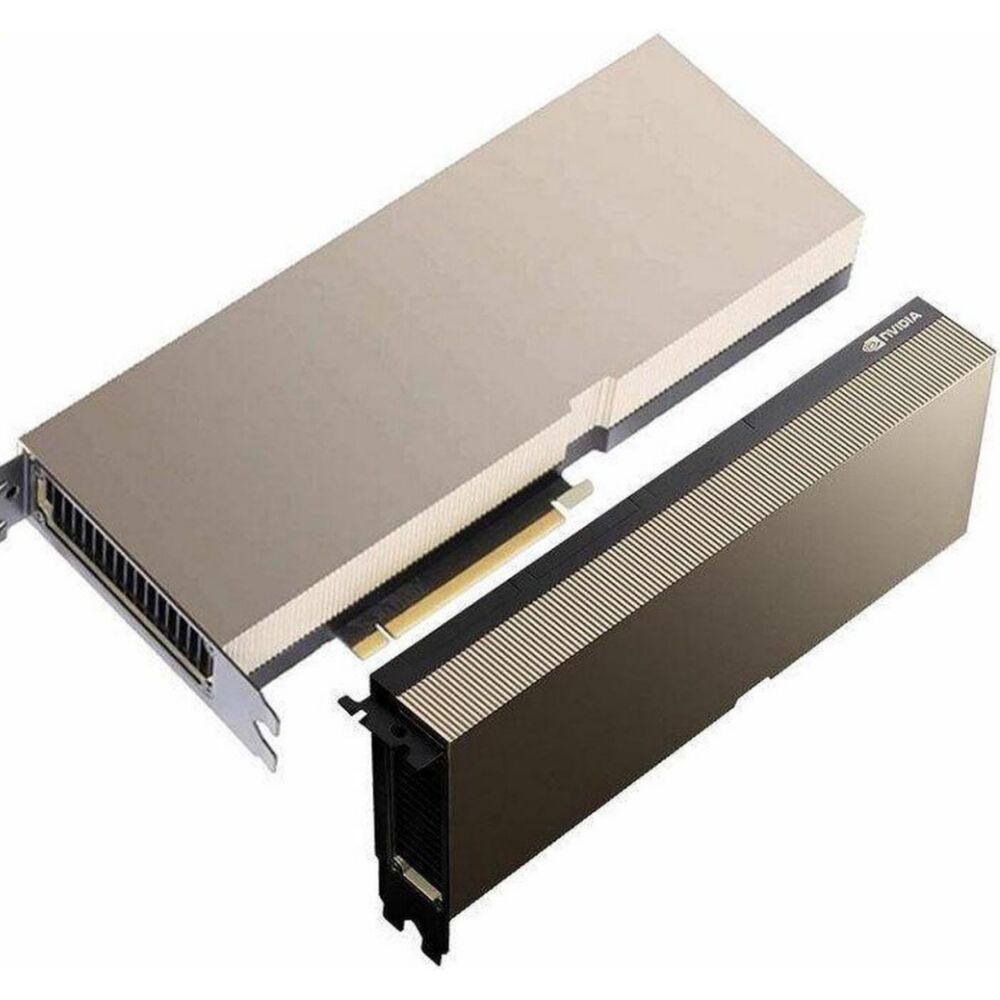

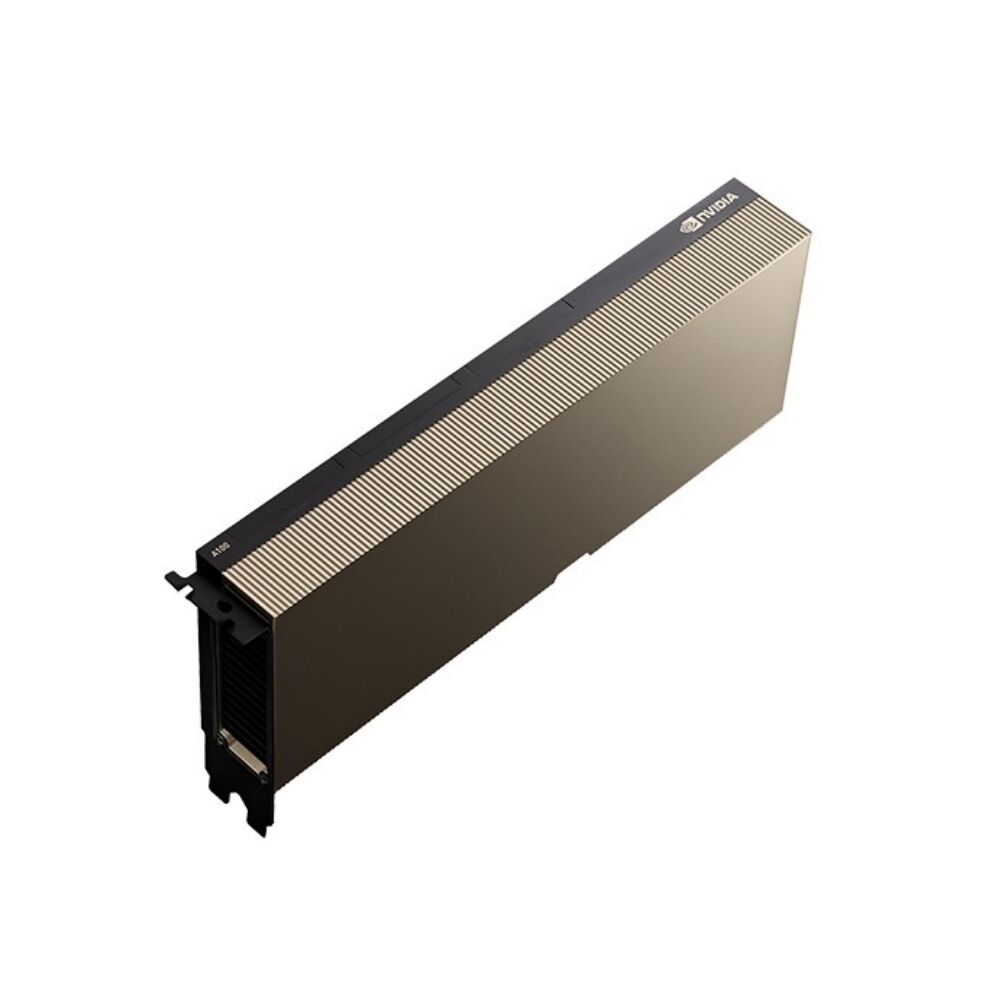

그래픽 카드---A100

사양

| A100 80GB PCIe | A100 80GB SXM | |

| GPU 메모리 | 80GB HBM2e | 80GB HBM2e |

| GPU 메모리 대역폭 | 1,935 GB/s | 2,039 GB/s |

| 멀티인스턴스 GPU | 최대 7개의 MIG(@10GB) | 최대 7개의 MIG(@10GB) |

| 형태 요인 | 피시 듀얼 슬롯 공랭식 또는 싱글 슬롯 액체 냉각식 |

SXM |

| 최대 열 설계 전력(TDP) | 300W | 400W |

문의하기

포장

인증